2023 年 4 月頃に申請を出していたのですが、ようやく GPT-4 が利用できるようになったので利用してみたいと思います。

当時の申請 ID は 8 万 3 千番台だったのですが、 7 月中旬に申請 ID を見たときには 18 万 4 千番台だったのでかなり処理がひっ迫している中でもなかなかたどり着かない感じがうかがえます。

ちなみに Outlook on the Web で、 Congratulations という文字が見つかると、パーティーモードを発動してくれるようです。

ポイントしたら紙吹雪が笑

早速中身を見てみましょう。

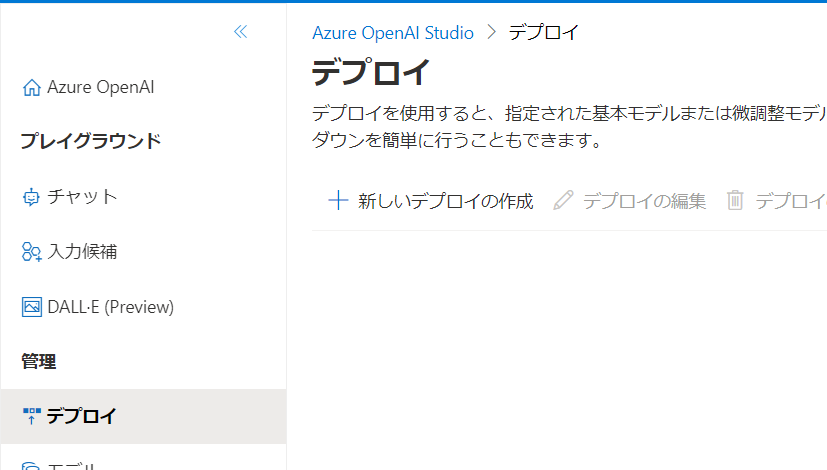

既存デプロイ済みの環境があったので、 Open AI Studio を起動してみていきます。

日本リージョンができたときに環境を作ったのですが、 GPT-4 へのアクセス権がなかったので、何もデプロイできなかったんですよね。

今回は新しいデプロイの作成を押して作れるか挑戦です。

許可された状態になっているためもちろん作成できるようになっていました。

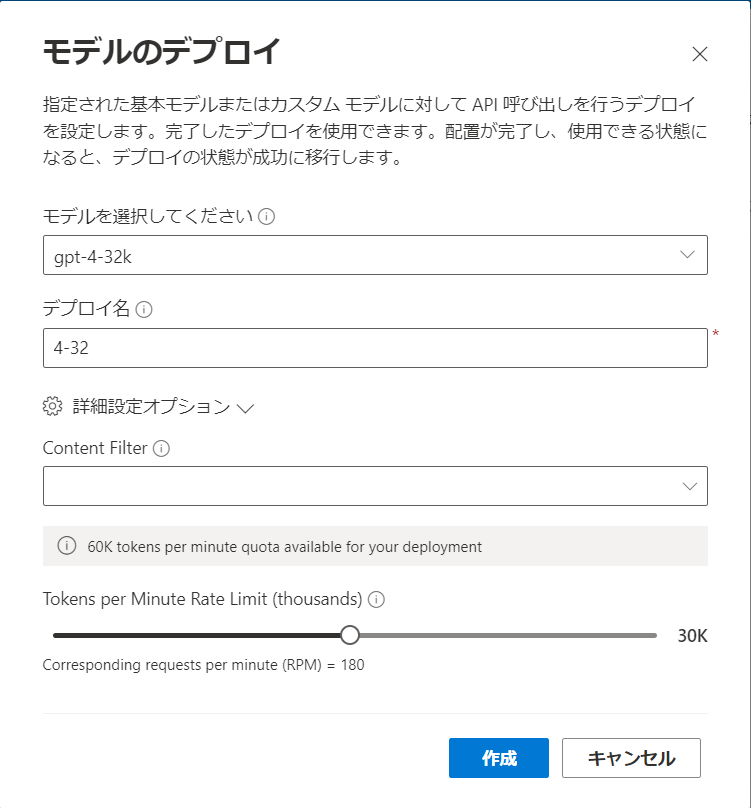

ベースモデルに gpt-4 と gpt-4-32k が出てきます。 32k はその名の通りトークン量が多いモデルですね。今のところ日本リージョンではこのあたりだけが作成できるようになっています。

gpt-4-32k を選択した際の詳細設定です。

1 分間に 60k トークンまでが許容されるようになっています。

最大値の 32k を目一杯使うと、 1 分 1 やり取りに限定される感じですね。

受付可能な最大リクエスト数もそれに準じて変動します。

ちなみにこの最大トークン数は、すべてのデプロイでの合計数となるようなので注意しましょう。複数のモデルを用意する場合は活動量を意識して調整することが重要ということですね。

ちなみにこの値、 gpt-4 ではまた別の数値のなっていました。

こちらの場合は最大 20k トークンまで。ということでリクエスト数も最大値が半分となっているみたいです。

さらに GPT-3 系では 240k のトークン量となっています。

計算の複雑性が低いのかと思いますが、大量アクセスを考えたときは gpt-3 系を使う必要がありそうですね。

デプロイが完了したら、モデルの非推奨となる日程が見えるようになります。 gpt-4-32k では 2024/1/15 までとなっていました。この、定期的にバージョンを差し替える必要がある。という点は運用前に使い方を決めておく必要がある点ですね。

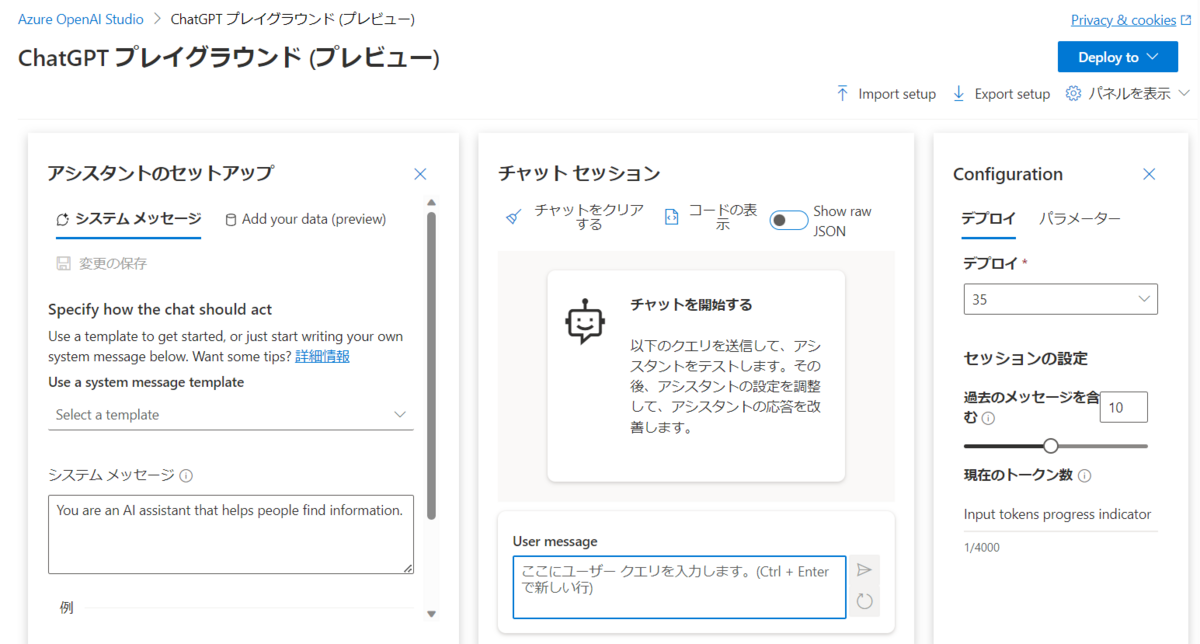

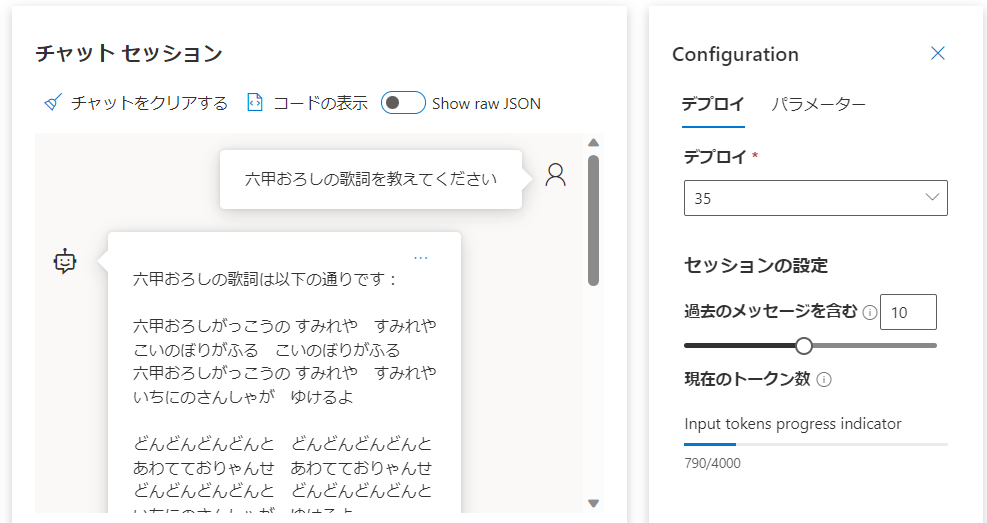

プレイグラウンドを見ていきましょう。

GPT-4 系は GPT-3 系とメニューが一部異なっています。もしかしたら日本リージョン限定の話かもしれませんが、そこまでは見切れていません。(以下は Japan East の環境です。)

こちらが GPT-3 系の画面です。

右側に Deploy to のボタンがあるのとアシスタントの個所に Add your data があるところが大きく違いますね。

簡易デプロイ機能がオミットされているということなので、利用時はインターフェースを考えてあげる必要がありそうです。

手っ取り早くやるなら Power Virtual Agent でしょうか。

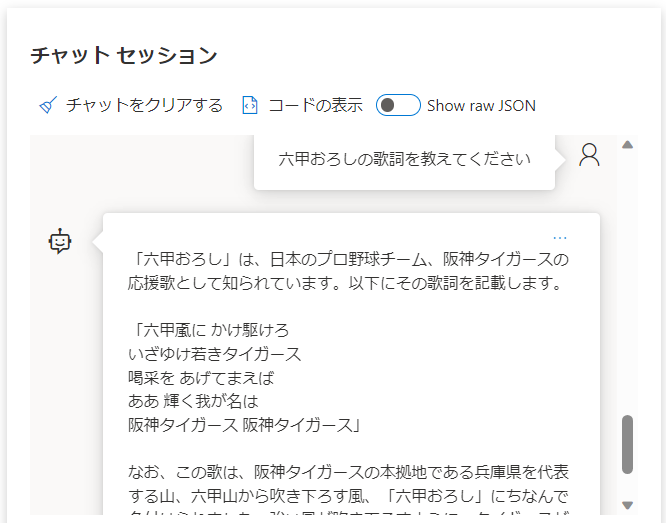

最後のに GPT-4 での応答を見てみましょう。

いい感じに内容は生成されていますね。

この辺りは GPT-3 と同様なので驚きは少ないです。

ただ、下部に意味を追記してくれるのが新しい感じですね。

より会話感が増したように見えるので、正統進化です。

GPT-3 で同様の質問を行ってみました。

こちらは名詞が拾えてこれておらず、おそらく言葉を入れて作詞したんじゃないかと思います。学習量の違いが意図の汲み方の差となる。というのが如実に出た結果ですね。

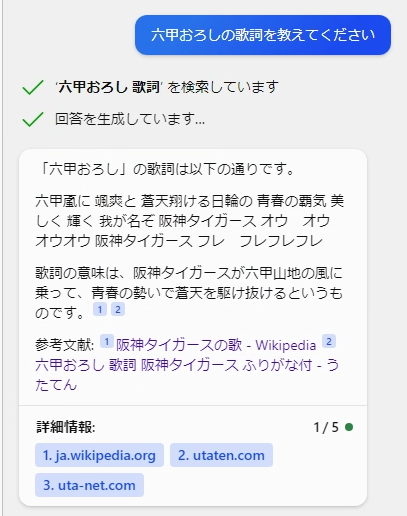

ちなみに同じ内容を Bing 検索連携してくれる Bing Chat で問い合わせてみると、、、、

こちらは正しい曲になっていそうです。

若干「?」が付いた部分があったのですが、参照元を見ると正しそうだったので問題ない範囲でしょう。

ちなみに Bing Chat も正しい答えが返るとは限らないので注意しましょう。

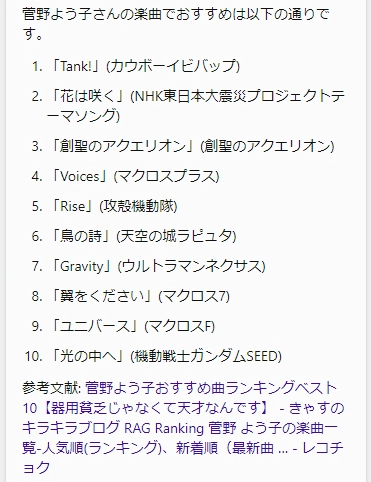

以下がその例です。

こんな感じにいくつかそうじゃないものが混じっています。

しかし、最近の進化の過程でか、写真が差し込まれるようになっており、驚きました。

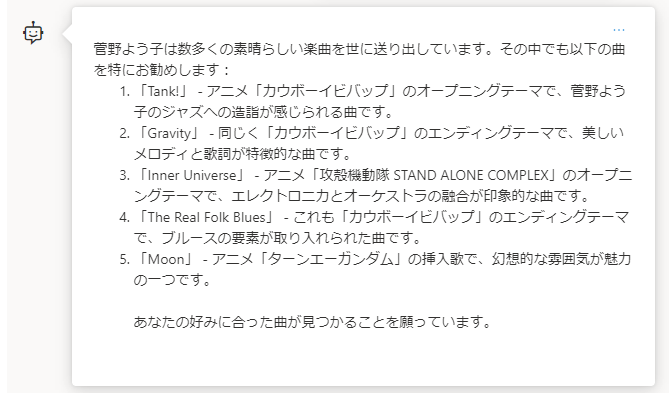

同じ内容を GPT-4 で聞いてみたらこうなります。

説明が若干怪しいことを除いて満足いく結果といえますね。そして前後の文章組み立て。これはよい感じです。

GPT-3 のケースはもうちょっとシンプルにまとめた感じです。こちらも説明は微妙に違うような。

このようにものによって回答が異なるところは利用するうえで覚えておきたいところとなります。

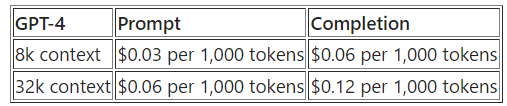

あとは GPT-4 は高いので、この辺りも忘れないようにしておきましょう。

音楽:東ヨーロッパ